Hello la team,

"4 millions de tokens par tâche. Facture mensuelle : 1 600$."

C'est la réalité de certains utilisateurs d’OpenClaw. L'assistant le plus puissant du marché est aussi le plus gourmand.

Mais une refonte architecturale permet de passer de 4M à 100k tokens maximum. Soit 97% de réduction.

Cette semaine, je vous montre exactement comment.

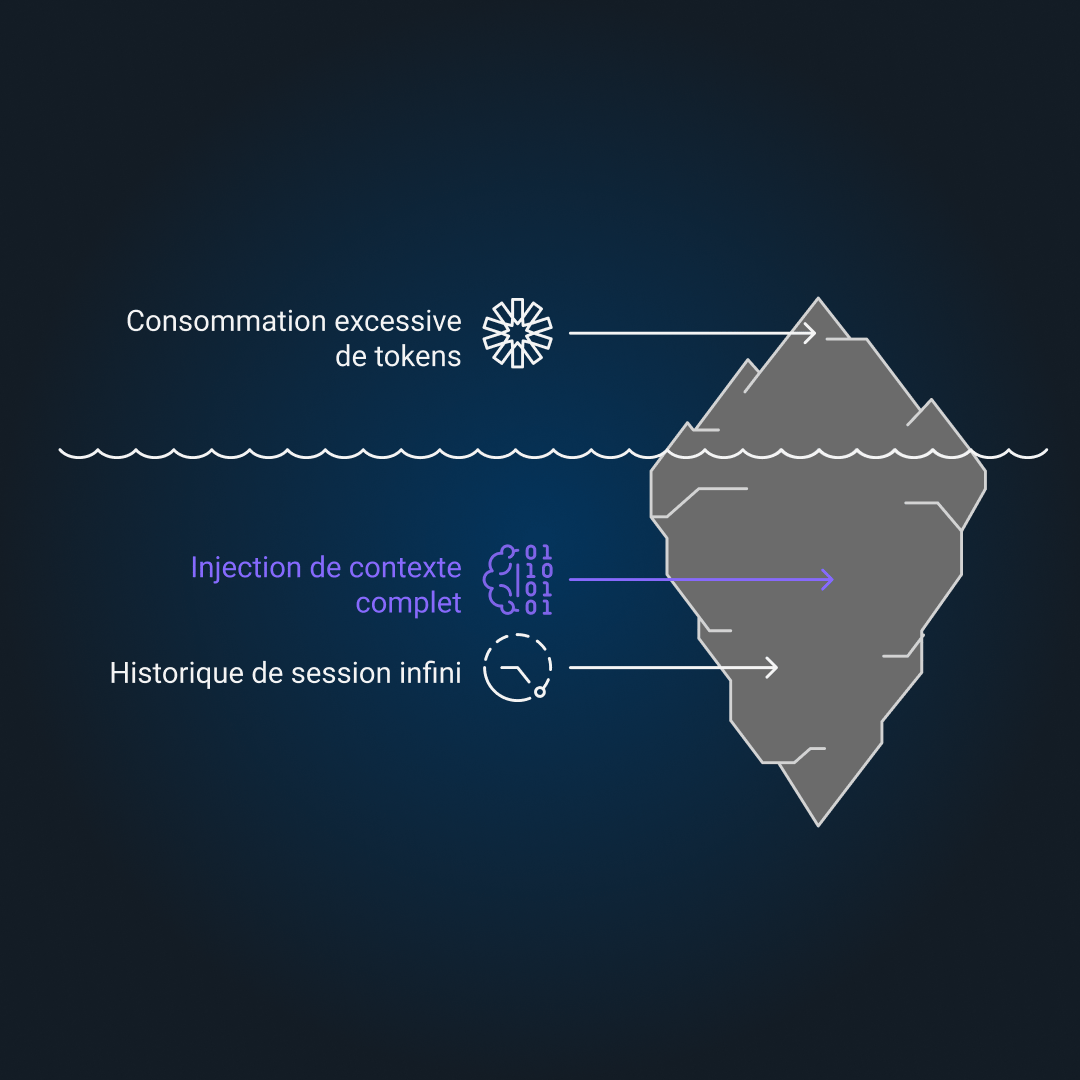

Le problème : une architecture pensée pour la puissance, pas l'efficacité

L'architecture par défaut d'OpenClaw a deux défauts majeurs :

→ Full Context Injection : tout le contexte est injecté à chaque requête

→ Infinite Session History : l'historique de session grossit sans limite

Résultat : même une question simple comme "Quelle heure est-il ?" peut consommer des centaines de milliers de tokens.

Le problème : la boucle de données exponentielle

À chaque prompt, OpenClaw recharge l'intégralité de ses composants :

Context Files

Soul (personnalité)

User Identity

Agents

Memory

Heartbeat

Tools

Bootstrap

Tout est stocké dans des fichiers JSONL :

~/.openclaw/agents.main/sessions/*.jsonlPlus vous utilisez OpenClaw, plus le contexte grossit, plus chaque requête coûte cher. C'est une spirale inflationniste.

Pour vérifier ton état :

openclaw /status🤖 Model: claude-sonnet-4 📊 Context: 234,567 / 400,000 tokens (58.6%) 💰 Estimated cost this session: $12.34

Si votre contexte dépasse 50%, vous payez déjà trop cher.

Les 5 opérations pour réduire de 97%

1 : Session dump - Vider l'historique

Les intégrations (Slack, Telegram, etc.) uploadent tout l'historique à chaque nouveau message.

Solution : Vider manuellement l'historique accumulé.

run slack_session_dump --clear

> Dumping session history...

> History cleared.

Token count resetBonne pratique : Reset après chaque tâche terminée. Ne laisse jamais le contexte s'accumuler.

2 : Memory caching - Éviter les relectures

Les fichiers mémoire sont statiques, mais réinjectés aveuglément à chaque prompt.

Solution : Activer le cache pour empêcher le rechargement.

def configure_system():

init_memory(cache=True, reload=False)

print("Static memory locked.")

→ Empêche le rechargement des fichiers mémoire statiques à chaque prompt.

3 : Context compression - Réduire la taille

Les fichiers de contexte bruts contiennent du formatage inutile.

Solution : Compression agressive.

{

"agents": {

"defaults": {

"contextTokens": 50000,

"compaction": "aggressive"

}

}

}Résultat : ~64% de réduction de taille du payload.

4 : Heartbeat throttling - Limiter les checks

Le processus Heartbeat peut brûler 3 millions de tokens en s'exécutant plusieurs fois par jour.

Solution : Limiter à une exécution quotidienne.

{

"system_schedule": {

"heartbeat_frequency": "once_daily"

}

}Économie : ~3,000,000 tokens sauvés.

5 : Model orchestration - Router intelligemment

Stratégie : "Don't use a sledgehammer to crack a nut"

Le principe :

Haiku comme agent principal (rapide, pas cher)

Sonnet uniquement pour les tâches complexes

User Input → Haiku Agent (Main) → Complexe ?

├─ Non → Output direct

└─ Oui → Sonnet Sub-Agent → Output

Ou mieux encore : MiniMax M2.5 qui rivalise avec Opus pour 95% moins cher.

Modèle | Prix Input | Usage |

|---|---|---|

Opus 4.6 | 15$/M | Raisonnement critique uniquement |

Sonnet 4.5 | 3$/M | Tâches complexes |

Haiku 4.5 | 1$/M | Agent principal |

MiniMax M2.5 | ~0.15$/M | Alternative globale |

Résultats : le benchmark

Métrique | Résultat |

|---|---|

Réduction totale | 97% |

Tokens Heartbeat sauvés | 3,000,000 |

Compression contexte | 64% |

Plafond max | 100k tokens |

Le protocole en 6 étapes

Action | Commande/Config |

|---|---|

AUDIT | Identifier les fuites de contexte |

DUMP |

|

CACHE |

|

COMPRESS |

|

THROTTLE |

|

ORCHESTRATE | Haiku = Main, Sonnet = Escalade |

Mon conseil

OpenClaw est gratuit. Mais mal configuré, il peut vous coûter plus cher qu'un employé.

La bonne nouvelle : avec ces 5 fixes, vous passez de 4 millions à 100k tokens par tâche. C'est la différence entre une facture de 150$/mois et 35$/mois.

La vraie question n'est plus "quel assistant IA utiliser ?" mais "comment l'optimiser pour qu'il soit rentable ?"

97% de réduction. C'est possible. Et maintenant vous savez comment.

Annonces

Ouverture des ateliers "Déployez votre flotte d'agents 24/7"

Dates : mardi 24, jeudi 26 février et mardi 3 mars de 12h-14h

Format : formation à distance en classe inversée, cours à votre rythme, puis sessions live en groupe (max 20 personnes).

Résultat : déploiement d'agents spécialisés disponibles 24/7, accessibles via Telegram, Slack ou WhatsApp sans coder.

Offre early adopter : 149 € jusqu'à Jeudi 19 puis 249 €

Accédez à l’offre 👉 https://formation.ai-corner.co/

Enjoy ✌️

— Lionel